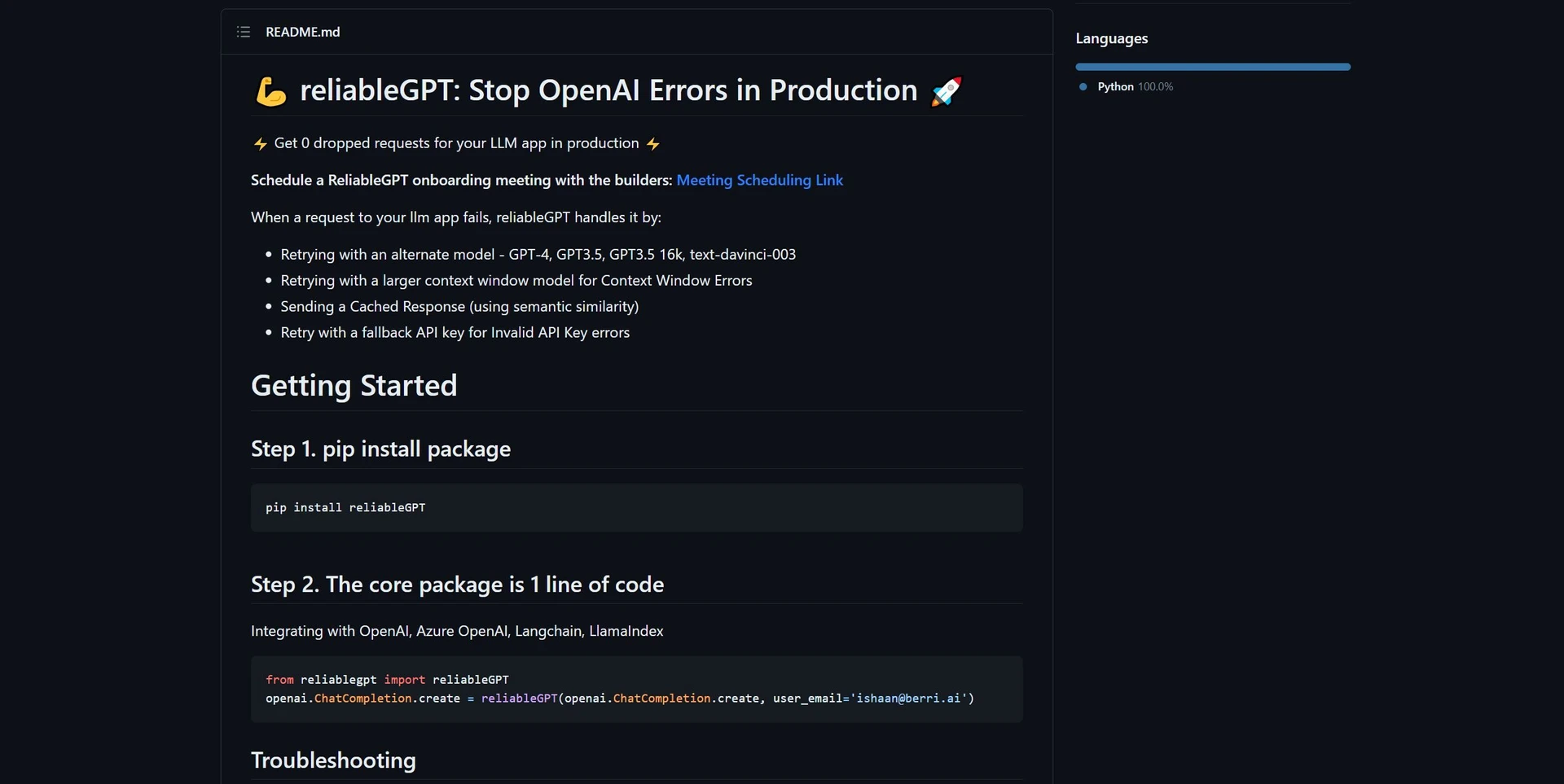

ReliableGPT prospera per essere un'utilità robusta programmata con precisione per garantire zero richieste incomplete durante l'esecuzione dell'applicazione Language Model (LLM) in una configurazione di produzione. Accede a una vasta gamma di tattiche di gestione degli errori come la rielaborazione con modelli alternativi, modelli di finestre di contesto più grandi, soluzioni memorizzate nella cache basate sulla somiglianza semantica e chiavi API di fallback per garantire la massima efficienza operativa.

Caratteristiche principali

Alternate Model Retry: un sistema efficace che riprova a elaborare le richieste non riuscite utilizzando diversi modelli come GPT-4, GPT3.5, GPT3.5 16k o text-davinci-003.

Modelli di finestra di contesto più grandi: una caratteristica unica che reitera le richieste con modelli di finestra di contesto più estesi progettati esplicitamente per risolvere gli errori della finestra di contesto.

Risposta memorizzata nella cache basata sulla somiglianza semantica: una fornitura intelligente di risposte memorizzate nella cache basate sulla somiglianza semantica per gestire efficacemente i problemi tecnici.

Fallback API Key Retry: una funzione failsafe che rielabora le richieste con una chiave API alternativa, gestendo efficacemente gli errori di "Chiave API non valida".

Passa da Azure OpenAI a OpenAI non elaborato: un'opzione flessibile per passare senza problemi da Azure OpenAI a OpenAI non elaborato in base alle tue esigenze specifiche.

Caching per server sovraccarichi: un meccanismo di caching del server pianificato con giudizio per gestire senza problemi i carichi del server gonfiati.

Gestione delle chiavi ruotate: una soluzione efficace per affrontare le rotazioni delle chiavi che interrompono le operazioni di servizio.

Casi d'uso

Stabilità dell'ambiente di produzione: uno strumento affidabile che garantisce un servizio coerente e continuo e zero richieste perse per l'applicazione LLM in esecuzione in un ambiente di produzione.

Gestione degli errori: soluzione completa agli errori, offrendo strategie alternative per ridurre al minimo le interruzioni.

Integrazione API fluida: lo strumento offre un'integrazione perfetta con l'API OpenAI gestendo abilmente potenziali errori e sfide.

ReliableGPT rappresenta una potente soluzione per garantire un'applicazione LLM impeccabile e senza interruzioni in esecuzione in produzione.