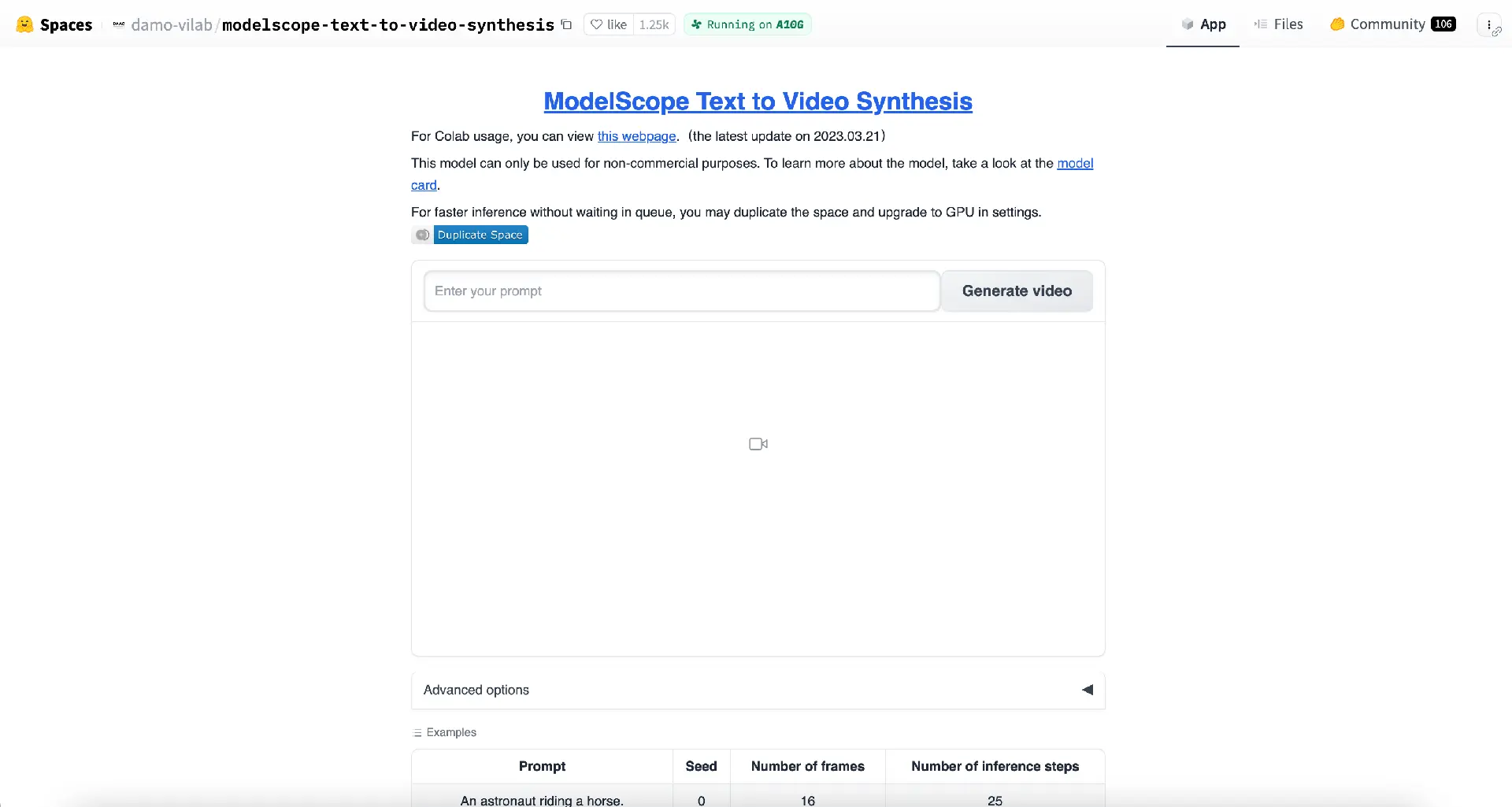

À propos de ModelScope Texte en vidéo

ModelScope, fondée en 2022 en Chine, présente l'outil innovant « Text to Video Synthesis ». Basée sur la plateforme Hugging Face, cette application d'apprentissage automatique de pointe peut convertir le contenu textuel en formats vidéo convaincants. Les utilisateurs peuvent exploiter cet outil pour générer de nombreux types de vidéos, du texte animé aux vidéos courtes, le tout en fournissant simplement une description textuelle.

Principales caractéristiques

Utilisation simple

Même ceux qui ne sont pas familiers avec l'apprentissage automatique peuvent facilement naviguer et utiliser l'outil, car il est conçu pour une utilisation conviviale.

Modèles et fichiers liés

Pour garantir des sorties vidéo de premier ordre, l'outil intègre des modèles et des fichiers liés, garantissant la conversion du texte en contenu visuellement attrayant.

Réglages avancés

Les utilisateurs ont la possibilité de personnaliser leurs sorties grâce à plusieurs paramètres avancés :

Configuration des semences: Permet aux utilisateurs de définir une valeur comprise entre -1 et 100 000, -1 impliquant une graine différente à chaque utilisation.

Sélection du cadre: Les utilisateurs peuvent sélectionner entre 16 et 32 images. Le contenu de la vidéo s'ajuste en fonction du nombre d'images choisi.

Étapes d'inférence: Le nombre d'étapes d'inférence peut varier entre 10 et 50.

Aperçu technique

La synthèse s'appuie sur un modèle de diffusion de génération texte-vidéo en plusieurs étapes. Ce modèle comporte trois sous-réseaux intégraux : l'extraction de caractéristiques de texte, le modèle de diffusion d'espace latent de caractéristique de texte vers vidéo et l'espace visuel d'espace latent vidéo vers vidéo. Avec un nombre impressionnant de 1,7 milliard de paramètres, le modèle ne prend en charge que la saisie en anglais. Le modèle de diffusion utilise la structure Unet3D, générant des vidéos via un processus de débruitage itératif à partir d'une vidéo de bruit gaussien pur.

Applications

L'outil de ModelScope se distingue par sa polyvalence. Voici quelques exemples de vidéos qu’il peut générer :

Un robot dansant à Times Square

Un poisson-clown naviguant à travers un récif de corail

La glace fond et coule sur son cornet

Une représentation surréaliste d'un chat mangeant de la nourriture dans le style de Van Gogh

Une image hyperréaliste d’un site industriel abandonné et orageux